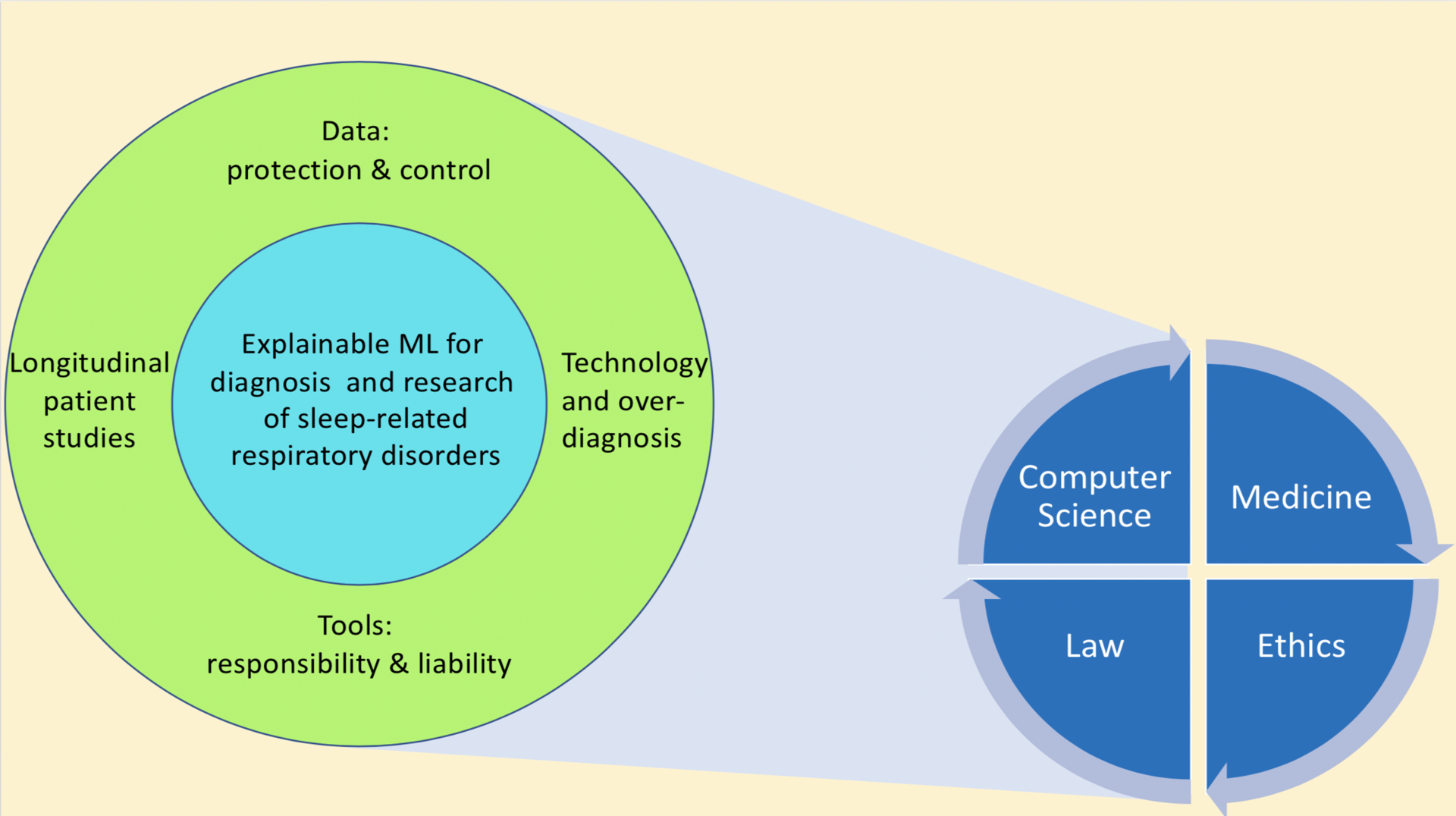

Enheter, som smartklokker, som kan samle helsedata fra "alle" hele tiden, og maskinlæring (ML) for å analysere disse dataene vil ha stor innvirkning på fremtidige helseløsninger. De kan muliggjøre lavkost screening i stor skala og langsiktig overvåking av individer for automatisk å oppdage endringer i deres helsestatus, for tidlig oppdagelse av udiagnostiserte sykdommer og for å tilpasse behandling av pasienter. Hvis det brukes uten refleksjon, er det også betydelige utfordringer, som (1) beskyttelse og kontroll av bruk av innsamlede data, (2) falske alarmer, helseangst, overdiagnostisering, påfølgende overbehandling og medikalisering, (3) pålitelighet, relevans og gyldighet av dataanalyseresultater, og (4) manglende evne til å forklare resultater oppnådd med moderne ML. Dette undergraver grunnleggende etiske prinsipper og juridiske rettigheter og kan hemme fruktbar bruk av ML i helsesektoren.

Disse utfordringene og mulighetene vil bli adressert av forskere fra informatikk, medisin, juss og etikk. Medisinsk fokus vil være på søvnrelaterte luftveislidelser, spesielt for spedbarn med luftveishindringer i øvre luftveier og pasienter som får via maske langvarig nattlig mekanisk støtte av ventilasjon.

Kjernen i Respire vil være et rammeverk for å definere hva som er gode forklaringer for ulike brukere (f.eks. helsepersonell, pasienter og ML-utviklere), og hvordan deres kvalitet kan evalueres. Som grunnarbeid vil vi undersøke: (1) bruken av overvåkingsdata fra mekaniske ventilatorer og ML for å forbedre og tilpasse behandlingen av pasienter, (2) forbrukerelektronikk for søvnovervåking av spedbarn hjemme og ML for å analysere overvåkingsdataene, (3) større juridiske og etiske bekymringer, med fokus på etiske prinsipper om autonomi og personvern, EUs databeskyttelseslovgivning og helselovgivning, og (4) forholdet mellom å oppdage og definere enheter som indikatorer, indekser, diagnoser og sykdommer; potensielle utfordringer forårsaket av falske alarmer.